Qu'est-ce que le DevOps

Le DevOps est une culture, un ensemble de pratiques et une philosophie qui visent a unifier le développement logiciel (Dev) et les operations informatiques (Ops). L'objectif est de raccourcir le cycle de développement, d'augmenter la frequence des deploiements et de garantir la fiabilité des applications en production. Le DevOps n'est pas un outil ni un titre de poste a l'origine : c'est une approche globale qui transforme la maniere dont les equipes construisent, testent, deployent et maintiennent les logiciels.

En pratique, le DevOps repose sur quatre piliers fondamentaux :

- L'automatisation : tout processus repetitif doit etre automatise, du build au deploiement en passant par les tests et le monitoring. L'automatisation reduit les erreurs humaines, accéléré les livraisons et libere du temps pour les taches a forte valeur ajoutee

- La collaboration : les equipes de développement et d'operations travaillent ensemble, partagent les responsabilites et communiquent en continu. Les silos organisationnels sont casses au profit d'equipes pluridisciplinaires

- La mesure : chaque aspect du système est mesure et monitore. Les metriques de performance, de disponibilité et de qualité guident les decisions et permettent l'amélioration continue

- Le partage : les connaissances, les outils et les bonnes pratiques sont partages au sein de l'organisation. La documentation, les post-mortems et la formation continue sont des elements centraux de la culture DevOps

En 2026, le DevOps n'est plus une option mais un standard. La quasi-totalite des entreprises technologiques ont adopte les pratiques DevOps, et le role d'ingénieur DevOps est devenu l'un des plus demandes sur le marche de l'emploi IT. Les entreprises qui n'ont pas encore adopte ces pratiques sont en train de le faire, ce qui généré un flux continu de recrutement. Le DevOps est aussi un tremplin naturel pour les développeurs qui souhaitent elargir leurs compétences, comme le montre notre guide sur comment devenir développeur web en 2026.

Le marche de l'emploi DevOps en France compte en permanence plus de 15 000 offres actives. Les profils qualifies sont rares et courtises, avec des salaires en progression constante. Le teletravail est largement repandu dans ce domaine, ce qui ouvre des opportunités aupres d'entreprises internationales.

Les compétences fondamentales du DevOps

L'ingénieur DevOps est un profil polyvalent qui combine des compétences en développement, en administration système et en gestion d'infrastructure cloud. Voici les compétences indispensables pour exercer ce métier en 2026.

Linux et administration système

La majorite des serveurs de production tournent sous Linux. Un ingénieur DevOps doit etre a l'aise avec l'administration Linux : gestion des processus, fichiers et permissions, configuration réseau, gestion des paquets, analyse de logs et diagnostic de problemes. La ligne de commande est l'outil principal du DevOps, et la maitrise de Bash est un prerequis non negociable.

Scripting et programmation

Le DevOps n'est pas un métier purement operationnel : c'est un role d'ingénieur qui implique d'ecrire du code quotidiennement. Python est le langage de scripting le plus utilise pour l'automatisation, les outils internes et les intégrations. Go est de plus en plus present dans l'ecosysteme DevOps (Docker, Kubernetes, Terraform sont ecrits en Go). La connaissance de frameworks backend comme Symfony est egalement un atout pour les DevOps qui collaborent avec des equipes de développement PHP. Bash reste indispensable pour les scripts système et les automatisations rapides.

Réseaux et sécurité

Comprendre les fondamentaux du réseau (TCP/IP, DNS, HTTP/HTTPS, load balancing, CDN) est essentiel pour configurer des infrastructures fiables et diagnostiquer des problemes de connectivite. La sécurité (DevSecOps) est de plus en plus intégrée dans le role DevOps : gestion des secrets, configuration des pare-feu, scanning de vulnerabilites, et mise en place de politiques de sécurité dans les pipelines CI/CD.

Cloud computing

La maitrise d'au moins un cloud provider (AWS, Azure ou GCP) est devenue indispensable. Le DevOps doit connaitre les services de compute (EC2, App Service, Compute Engine), de stockage (S3, Blob Storage, Cloud Storage), de réseau (VPC, NSG, Firewall Rules) et de bases de données managees. Les services serverless et les architectures event-driven font egalement partie du repertoire du DevOps moderne.

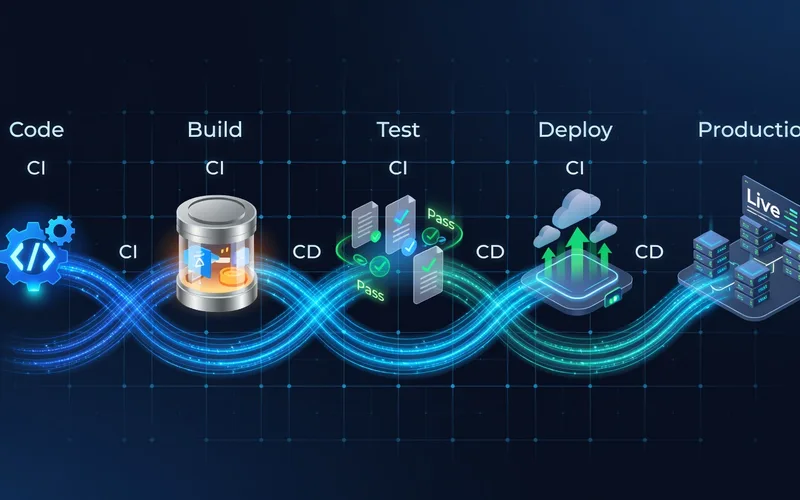

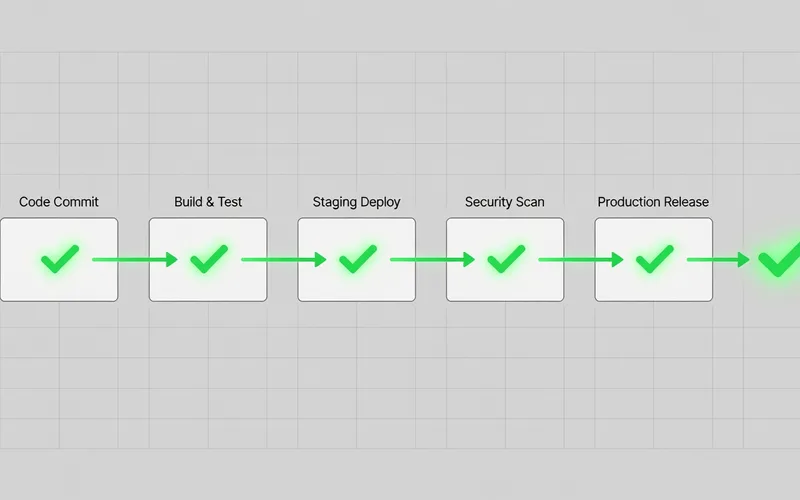

CI/CD : le coeur du pipeline DevOps

Le CI/CD (Continuous Intégration / Continuous Deployment) est le processus central du DevOps. Il automatise l'ensemble du cycle de livraison logicielle, du commit du code au deploiement en production.

L'intégration continue (CI)

L'intégration continue consiste a fusionner frequemment le code de tous les développeurs dans une branche commune, et a lancer automatiquement une serie de verifications a chaque fusion : compilation, tests unitaires, tests d'intégration, analyse de code statique et scanning de sécurité. L'objectif est de detecter les problemes le plus tot possible dans le cycle de développement, quand ils sont encore faciles et peu couteux a corriger.

Un pipeline CI typique comprend : le checkout du code, l'installation des dependances, la compilation ou le build, l'execution des tests unitaires, l'analyse de code (linting, formatage), le scanning de sécurité (SAST, SCA), et la construction de l'artefact deployable (image Docker, package). Chaque etape doit etre rapide (le pipeline complet devrait idealement durer moins de 10 minutes) et fournir un feedback clair aux développeurs.

Le deploiement continu (CD)

Le deploiement continu etend l'intégration continue en automatisant le deploiement des artefacts valides vers les environnements de staging et de production. Les stratégies de deploiement incluent le blue-green deployment (deux environnements identiques avec basculement), le canary deployment (deploiement progressif a un pourcentage d'utilisateurs) et le rolling update (mise a jour progressive des instances).

Les outils CI/CD en 2026

GitHub Actions est devenu l'outil CI/CD le plus utilise, grace a son intégration native avec GitHub et sa marketplace d'actions reutilisables. GitLab CI/CD reste très populaire dans les entreprises qui utilisent GitLab comme plateforme. Jenkins, bien que vieillissant, est encore present dans de nombreuses organisations. ArgoCD et Flux sont les outils de référence pour le GitOps, une approche ou Git sert de source de verite pour l'etat desire de l'infrastructure et des applications.

Docker et la conteneurisation

Docker a revolutionne la maniere dont les applications sont construites, distribuees et executees. La conteneurisation est devenue un standard dans le développement logiciel moderne, et la maitrise de Docker est une compétence essentielle pour tout ingénieur DevOps.

Comprendre les conteneurs

Un conteneur est un environnement d'execution leger et isole qui encapsule une application avec toutes ses dependances (bibliotheques, runtime, fichiers de configuration). Contrairement aux machines virtuelles, les conteneurs partagent le noyau du système d'exploitation hote, ce qui les rend beaucoup plus legers et rapides a demarrer. Docker standardise la création et la gestion des conteneurs, assurant que l'application fonctionne de maniere identique sur le poste du développeur, en test et en production.

Ecrire un Dockerfile efficace

Le Dockerfile definit les instructions pour construire une image Docker. Un Dockerfile bien ecrit est essentiel pour la sécurité, la performance et la maintenabilite des conteneurs. Les bonnes pratiques incluent : utiliser des images de base minimales (Alpine, distroless), exploiter le cache de build avec un ordonnancement judicieux des instructions, effectuer des builds multi-stage pour reduire la taille finale de l'image, et ne jamais inclure de secrets dans l'image.

Docker Compose pour les environnements multi-services

Docker Compose permet de definir et de gérer des applications composees de plusieurs conteneurs (application web, base de données, cache, file de messages) dans un seul fichier YAML. C'est l'outil de référence pour les environnements de développement locaux et les tests d'intégration. Un fichier docker-compose.yml bien structure facilite l'onboarding des nouveaux développeurs et garantit la coherence des environnements.

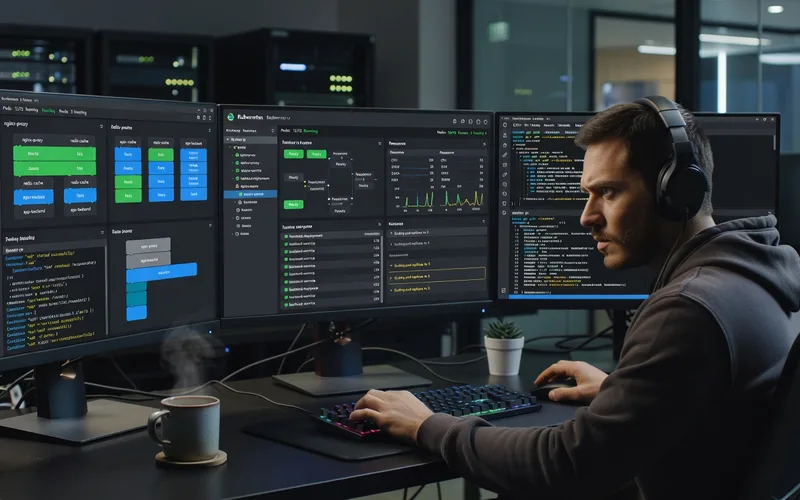

Kubernetes : l'orchestration a grande echelle

Kubernetes (K8s) est le système d'orchestration de conteneurs de référence, utilise par la majorite des entreprises pour gérer leurs applications en production. Créé par Google et maintenu par la Cloud Native Computing Foundation (CNCF), Kubernetes automatise le deploiement, la mise a l'echelle et la gestion des applications conteneurisees.

Les concepts fondamentaux

Kubernetes organise les conteneurs en Pods (l'unite de deploiement de base), les expose via des Services (point d'acces réseau stable), les deploie avec des Deployments (gestion du cycle de vie et des mises a jour) et stocke les données avec des PersistentVolumes. Le Namespace permet d'isoler les ressources au sein d'un meme cluster. Maitriser ces concepts est indispensable pour travailler avec Kubernetes en production.

Les distributions Kubernetes

En production, les entreprises utilisent generalement des distributions managees : Amazon EKS (AWS), Azure Kubernetes Service (AKS), Google Kubernetes Engine (GKE) ou des solutions on-premise comme Rancher et OpenShift. Pour l'apprentissage et les tests, minikube, kind et k3s permettent de faire tourner un cluster Kubernetes localement. Le choix de la distribution depend de l'infrastructure cloud de l'entreprise et de ses exigences en matiere de controle et de personnalisation.

L'ecosysteme cloud-native

Kubernetes est au centre d'un ecosysteme riche d'outils complementaires : Helm pour la gestion des packages Kubernetes, Istio et Linkerd pour le service mesh, Kustomize pour la personnalisation des manifestes, et les CRD (Custom Resource Definitions) pour etendre les fonctionnalites de Kubernetes. L'ingénieur DevOps doit connaitre cet ecosysteme pour construire des plateformes cloud-native robustes et maintanables.

Infrastructure as Code avec Terraform

L'Infrastructure as Code (IaC) est le principe selon lequel l'infrastructure informatique est gérée et provisionnee a travers du code plutot que par des processus manuels. Terraform, développé par HashiCorp, est l'outil IaC le plus utilise dans l'industrie.

Pourquoi l'Infrastructure as Code

L'IaC apporte les memes avantages au provisionning d'infrastructure que le controle de version au code applicatif : reproductibilite (chaque environnement est créé de maniere identique), traceabilite (chaque modification est versionnee dans Git), automatisation (le provisioning est declenche automatiquement), et collaboration (l'infrastructure est revue et approuvee par l'equipe via des pull requests). C'est la fin des configurations manuelles, des environnements "snowflake" et des documentations perimees.

Terraform en pratique

Terraform utilise un langage declaratif appele HCL (HashiCorp Configuration Language) pour decrire l'etat desire de l'infrastructure. L'outil calcule automatiquement les modifications nécessaires pour atteindre cet etat et les applique de maniere controlee. Terraform supporte tous les principaux cloud providers (AWS, Azure, GCP) ainsi que des dizaines de services tiers (Cloudflare, Datadog, GitHub), ce qui en fait un outil universel.

Les bonnes pratiques Terraform incluent : utiliser des modules reutilisables pour eviter la duplication, stocker l'etat distant (remote state) dans un backend securise (S3, Azure Blob), utiliser des workspaces ou des repertoires separes pour les differents environnements, et implementer un workflow de review (terraform plan dans les pull requests) avant chaque modification.

Alternatives a Terraform

Pulumi permet d'ecrire l'IaC dans des langages de programmation generaux (Python, TypeScript, Go) plutot qu'en HCL, ce qui convient aux equipes qui preferent utiliser un seul langage. AWS CloudFormation et Azure Bicep sont des solutions natives de chaque cloud provider. Ansible est souvent utilise en complement de Terraform pour la gestion de la configuration des serveurs. La formation continue sur les meilleures formations en ligne en 2026 inclut desormais systematiquement l'IaC dans ses programmes.

Monitoring, observabilite et incident response

Le monitoring et l'observabilite sont les yeux et les oreilles du DevOps. Sans visibilité sur l'etat des systèmes, il est impossible de garantir leur fiabilité et de reagir rapidement aux incidents.

Les trois piliers de l'observabilite

L'observabilite repose sur trois types de données complementaires : les metriques (données numeriques mesurant l'etat du système : CPU, memoire, latence, taux d'erreur), les logs (enregistrements textuels des evenements du système) et les traces (suivi du parcours d'une requete a travers les differents services d'une architecture distribuee). La combinaison de ces trois sources de données permet de comprendre ce qui se passe dans le système, de detecter les anomalies et de diagnostiquer les problemes.

Prometheus et Grafana

Prometheus est le système de monitoring de référence dans l'ecosysteme cloud-native. Il collecte et stocke les metriques, et fournit un langage de requete puissant (PromQL) pour les analyser. Grafana est l'outil de visualisation le plus utilise, permettant de créer des tableaux de bord personnalises qui affichent les metriques en temps reel. L'alerting peut etre configure dans Prometheus ou dans Grafana pour notifier les equipes lorsqu'un seuil critique est depasse.

La gestion des logs

La stack ELK (Elasticsearch, Logstash, Kibana) reste la solution de gestion de logs la plus deploiee, bien que des alternatives comme Loki (optimise pour Kubernetes) et Fluentd gagnent du terrain. La centralisation des logs est essentielle pour diagnostiquer les problemes dans des architectures distribuees ou les applications sont reparties sur des dizaines ou des centaines de conteneurs.

L'incident response

La gestion des incidents est une responsabilite clé du DevOps. Un processus d'incident response bien defini comprend : la detection (alerting automatique), le triage (evaluation de la severite), la remediation (resolution du probleme), la communication (mise a jour des equipes et des utilisateurs) et le post-mortem (analyse des causes racines et actions preventives). Des outils comme PagerDuty, OpsGenie et Incident.io facilitent la gestion des incidents et les rotations d'astreinte.

Salaires, certifications et parcours de formation

L'ingénieur DevOps fait partie des profils les mieux remuneres du secteur IT, et la demande continue de croitre en 2026.

Grille salariale DevOps en France

| Profil | Salaire brut annuel | TJM Freelance |

|---|---|---|

| DevOps Junior (0-2 ans) | 38 000 - 48 000 EUR | 400 - 600 EUR |

| DevOps Confirme (3-5 ans) | 50 000 - 68 000 EUR | 550 - 800 EUR |

| DevOps Senior (6+ ans) | 68 000 - 90 000 EUR | 700 - 950 EUR |

| Lead DevOps / SRE (8+ ans) | 80 000 - 110 000 EUR | 800 - 1 200 EUR |

Les certifications les plus valorisees

Les certifications jouent un role important dans le recrutement DevOps :

- Certified Kubernetes Administrator (CKA) : la certification DevOps la plus respectee, basee sur un examen pratique de 2 heures dans un environnement reel

- AWS DevOps Engineer Professional : valide les compétences en CI/CD, monitoring et automatisation sur AWS

- Azure DevOps Engineer Expert (AZ-400) : couvre les pratiques DevOps dans l'ecosysteme Microsoft

- HashiCorp Terraform Associate : certifie les compétences en Infrastructure as Code avec Terraform

- Docker Certified Associate : valide la maitrise de Docker et de la conteneurisation

Parcours de formation

Pour devenir ingénieur DevOps, plusieurs parcours sont possibles. Les développeurs en poste peuvent evoluer en integrant progressivement les outils DevOps dans leur pratique quotidienne : Docker pour les environnements de développement, puis CI/CD, puis cloud et Kubernetes. Les administrateurs système peuvent se former a l'automatisation, a l'IaC et au cloud. Les profils en reconversion complete doivent compter 12 a 18 mois de formation intensive, en combinant des cours en ligne (KodeKloud, A Cloud Guru, Linux Academy), de la pratique sur des projets personnels (homelab) et la preparation de certifications.

Construire un homelab

Le homelab est un environnement de pratique personnel ou vous deployz vos propres services et experimentez les outils DevOps. Vous pouvez créer un cluster Kubernetes local avec k3s, deployer des applications avec Helm, configurer un pipeline CI/CD avec GitHub Actions, et monitorer le tout avec Prometheus et Grafana. Un homelab documente sur GitHub est un excellent ajout a votre portfolio et impressionne les recruteurs lors des entretiens.

Le DevOps est un domaine en evolution permanente. Les pratiques se sophistiquent (GitOps, Platform Engineering, Internal Developer Platforms), de nouveaux outils emergent régulièrement, et les attentes des entreprises augmentent. L'ingénieur DevOps qui reussit est celui qui cultive une curiosite permanente, investit dans la formation continue et reste connecte a la communauté. C'est un métier exigeant mais passionnant, qui offre des perspectives de carriere exceptionnelles.